OpenAIは、同社が直近で経験したコードのセキュリティ問題に関連し、ハッカーが一部の従業員の端末からデータを窃取したことを明らかにした。同社は被害が一部の従業員デバイスに限定され、ユーザーデータや本番システムへの影響はなく、中核的な知的財産も盗まれていないと説明している。

事業継続を揺るがす標的型攻撃の実態

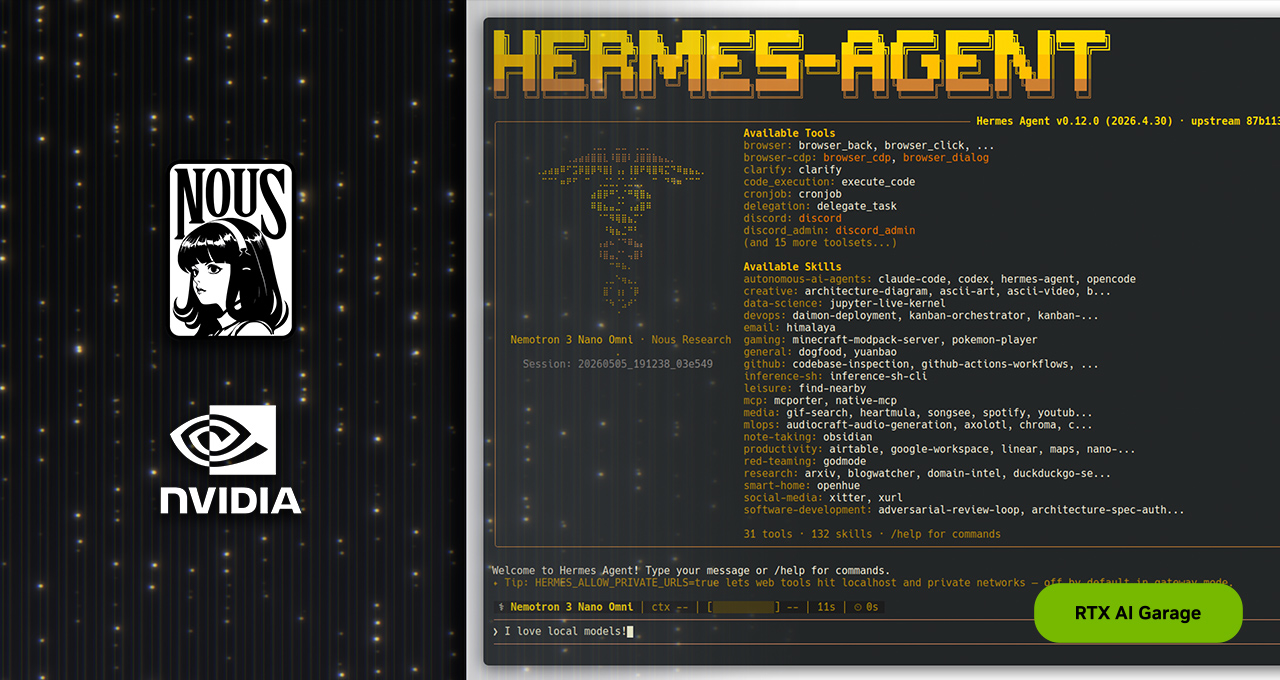

今回のインシデントは、OpenAIが生成AI技術の急速な商用化を進める中で発生した。攻撃者は同社の内部コード管理システムに対するセキュリティ上の弱点を突き、限定的な従業員のデバイスへ不正に侵入した。侵入経路や具体的な攻撃手法の詳細は公表されていないが、同社の広報担当者によれば、初期調査でユーザーの対話履歴や個人情報が格納されたデータベースへのアクセスは一切確認されなかったという。

被害に遭った従業員端末に保存されていた情報の範囲について、OpenAIは「個人を特定できる顧客情報やサービスの中核を成す秘密情報は含まれない」と強調する。今回の問題は、サイバー攻撃の対象がもはや単なるサーバー室やネットワーク機器にとどまらず、テレワークや分散開発が常態化する中で、個々の従業員端末が国家レベルのスパイ活動や産業スパイの主要な侵入口になり得る現実を浮き彫りにした。

機械学習モデルと製品への影響範囲

OpenAIの声明で最も市場関係者の懸念を和らげたのは、主力製品のGPT-4やChatGPTの基盤モデル、そしてそれらを動作させる本番環境システムが一切侵害されなかった点である。仮に学習済みモデルの重みやアーキテクチャが流出していれば、競合他社や敵対的国家による模倣が容易になりかねない。同社の説明では、攻撃者がアクセスできたのはあくまで補助的な社内ツールに関する情報の一部であり、製品の安全性を損なうコア技術の漏洩は発生していない。

加えて、ユーザーから預かるデータを保護するための暗号化とアクセス制御が、今回の攻撃経路から物理的・論理的に隔離されていたことが奏功した。あるセキュリティ専門家は、企業価値の源泉である巨大言語モデルと顧客情報の両方を守りきったことは、事後対応としては最低限の結果だが、標的型攻撃の侵入を許した事実そのものが、同社の情報管理ガバナンスに再考を促すものだと指摘する。

繰り返される内部脅威とセキュリティ投資の加速

OpenAIを巡っては、2023年春にも内部システムの不具合により一部ユーザーの支払い情報と対話タイトルが他の利用者から可視化される問題を起こしている。その際も生成AIの普及を背景に機密情報やプロンプトの取り扱いが世界的な注目を浴びたが、今回は意図的な攻撃による内部ネットワークへの侵入という点で、脅威の質が一段と深刻化している。

テック系調査会社CBインサイツのアナリスト予測では、グローバルなAIセキュリティ関連支出は年平均30%超の成長が見込まれており、2025年までに80億ドル規模へ拡大するとされる。OpenAIの事例は、研究機関的な気質を残すAI企業が、金融機関や重要インフラ事業者と同等の厳格なサイバー防御を求められる時代に突入したことを示している。

個人情報保護規制と日本企業が学ぶべき教訓

欧州連合の一般データ保護規則(GDPR)やカリフォルニア州消費者プライバシー法(CCPA)は、顧客データの安全確保を事業者に義務付けている。OpenAIは今回「ユーザーデータへの侵害はない」と断言しており、多額の制裁金や訴訟に発展する直接的な法的リスクは回避した格好だ。しかし、各国の規制当局は生成AI事業者に対して内部脅威の管理体制についてもより厳格な説明責任を求め始めている。

この構図は日本市場にも無縁ではない。すでに大手企業を中心に、ChatGPTエンタープライズ版の導入が進み、機密性の高い社内文章を外部のAIモデルに処理させる業務フローが常態化しつつある。日本の情報セキュリティ監査を手掛ける専門家は、OpenAIのインシデントを、自社のアクセス権管理と従業員端末の監視レベルを見直す契機と捉えるべきだと警鐘を鳴らす。サプライチェーンの一部として海外のAI基盤を利用する際、契約相手のインフラ自体は堅牢でも、その内部に侵入した第三者が日本人技術者の端末を経由して情報を抜き取るリスクは常に存在する。

先端AI開発を取り巻くエコシステムの地殻変動

OpenAIは7月、マイクロソフトを含む投資家から100億ドル超の資金を調達して以降、企業向けサービスの拡充と並行して政府機関との連携を強化している。機密情報を扱う官公需を獲得するには厳格なセキュリティ基準を満たす必要があり、今回の公表は透明性を重視した対応策とみることもできる。

半導体大手エヌビディアは、AI開発専用のセキュアなコンピューティング環境をクラウド事業者に提供し始めており、データのライフサイクル全体を保護する動きが加速している。サイバーセキュリティ企業パロアルトネットワークスは、生成AIを悪用した攻撃の自動化が2024年に急増すると予測する。OpenAIの一件は、技術力を競う段階から、その技術を安全に社会実装するための防御力と説明責任を問われる段階へ、生成AI産業の重心が移行しつつあることを物語っている。